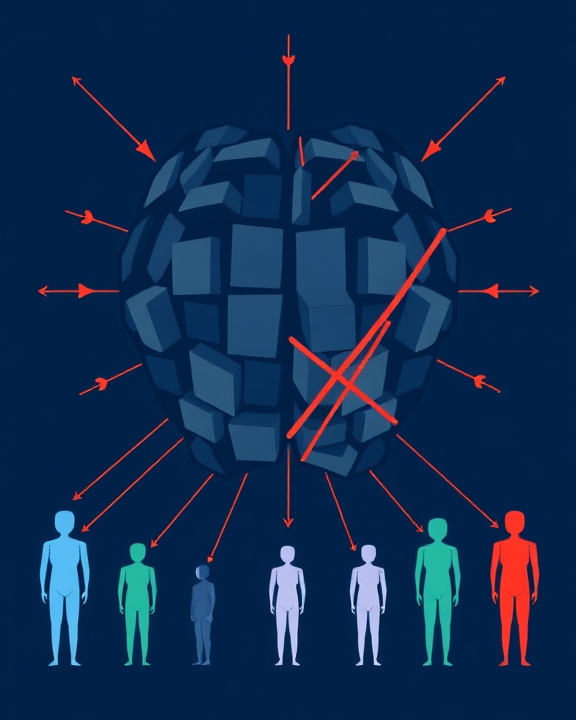

- I bias nei dati portano a sottodiagnosi o sovragnosi per minoranze etniche.

- Oltre il 70% dei dati per l'ia medica proviene da specifici gruppi.

- Casi documentati dal 2018: discriminazione nei sistemi di supporto decisionale.

L’ombra invisibile degli algoritmi: distorsioni nella diagnosi della salute mentale

Nel dinamico paesaggio della medicina moderna, l’intelligenza artificiale (IA) sta emergendo come uno strumento rivoluzionario, promettendo di affinare l’accuratezza diagnostica e personalizzare i percorsi terapeutici. Tuttavia, un’indagine approfondita rivela una crepa etica nella fondazione di questi sistemi, particolarmente evidente nel delicato campo della salute mentale. Il problema risiede nel “bias algoritmico”, un fenomeno insidioso che può compromettere l’equità e la precisione delle diagnosi. Questa problematica non è un mero dettaglio tecnico, ma una questione di fondamentale importanza etica e sociale, poiché incide direttamente sulla vita e sul benessere di milioni di persone, minacciando di esacerbare disuguaglianze esistenti e di generare nuove forme di discriminazione nel settore medico.

I pregiudizi impliciti nei set di dati utilizzati per addestrare gli algoritmi di intelligenza artificiale sono il cuore pulsante di questa criticità. Tali dati, spesso collezioni immense di informazioni cliniche, anamnesi e risultati di test, possono riflettere e persino amplificare disparità sociali e culturali preesistenti. Ad esempio, se un set di dati è prevalentemente composto da informazioni demografiche relative a un gruppo etnico o socioeconomico specifico, l’algoritmo che ne deriva potrebbe sviluppare una “visione” distorta, meno precisa o addirittura errata, quando chiamato a valutare individui appartenenti ad altri gruppi. Uno studio recente ha evidenziato che la rappresentazione sproporzionata di determinate fasce della popolazione nei database di riferimento può portare a una sottodiagnosi o sovragnosi per minoranze etniche, con conseguenze potenzialmente devastanti sulla tempestività e l’efficacia delle cure. Le implicazioni di tali errori sono molto più gravi di un semplice errore statistico; possono significare percorsi terapeutici inappropriati, ritardi nella diagnosi di condizioni gravi o, peggio ancora, la stigmatizzazione basata su inferenze algoritmiche errate.

Gli esperti di etica dell’IA e i pazienti che hanno vissuto in prima persona l’impatto di queste tecnologie condividono le loro testimonianze, offrendo una prospettiva cruciale su questa sfida emergente. Un paziente intervistato ha raccontato come, dopo aver utilizzato un’applicazione diagnostica basata sull’IA, gli sia stata suggerita una diagnosi che non teneva conto delle sue specifiche peculiarità culturali, portandolo a dubitare dell’efficacia del sistema e a ritardare la ricerca di un aiuto professionale. Un’esperta di etica dell’IA ha sottolineato che “gli algoritmi non sono neutrali, ma sono uno specchio delle disuguaglianze presenti nella società umana che li produce”, evidenziando come la cura e l’attenzione nella selezione e nell’equilibrio dei dati siano imperative. Questi racconti non sono aneddoti isolati; sono segnali d’allarme che indicano la necessità di un’azione concertata per garantire che l’innovazione tecnologica in campo medico proceda di pari passo con un’etica rigorosa e un impegno costante per l’equità, affinché la promessa di una salute migliore non si trasformi in una nuova forma di disparità.

I molti volti della disuguaglianza digitale nella salute mentale

Il confronto riguardante il bias algoritmico si interconnette in modo profondo alla comprensione delle significative ripercussioni associate all’avanzamento tecnologico, specialmente nei contesti sensibili come quello della salute mentale. Non ci si deve limitare a considerare unicamente il software oppure i dataset utilizzati: è necessaria un’analisi dell’intero panorama relativo allo sviluppo, all’implementazione e alla legislazione sull’IA. Attualmente emerge che oltre il 70% dei dati impiegati per formare modelli intelligenti nel campo medico derivano da specifici gruppi popolazionali; tale circostanza determina una marcata sottorappresentanza di categorie quali le minoranze etniche, le donne, gli anziani e gli individui affetti da malattie rare o complesse, relegando il restante 30% in una posizione marginale nella ricerca scientifica. Tale disuguaglianza non rappresenta un fatto fortuito; essa deriva infatti dall’incidenza storica e sociale che ha privilegiato determinati aggregati demografici nella raccolta dei dati rispetto ad altri.

Le ripercussioni generate da questa disparità risultano ampie ed allarmanti. Ad esempio, algoritmi progettati sulla base prevalente di informazioni relative a pazienti maschi bianchi mostrano una significativa riduzione nell’affidabilità diagnostica relativamente alla depressione nelle donne; ciò avviene grazie alle diverse espressioni sintomatiche ed emotive potenzialmente legate sia alla cultura che al sesso biologico degli individui coinvolti. Similmente, in contesti in cui i disturbi psicotici sono culturalmente stigmatizzati o interpretati diversamente, i sistemi di IA possono non riconoscere i segnali precoci o interpretare erroneamente i comportamenti, portando a ritardi significativi nel trattamento. Questi “punti ciechi” algoritmici non sono solo un problema di efficienza, ma una questione di giustizia sociale, poiché le fasce più vulnerabili della popolazione, già gravate da disparità socioeconomiche, si trovano a dover affrontare un’ulteriore barriera nell’accesso a una cura equa e tempestiva.

L’impatto del bias non si limita alla diagnosi iniziale; si estende alla prescrizione di trattamenti e alla gestione a lungo termine delle patologie mentali. Un algoritmo che sottostima la gravità di un disturbo in una determinata demografia potrebbe suggerire interventi meno intensivi o inappropriati, ritardando l’accesso a terapie essenziali. Al contrario, un’eccessiva categorizzazione o uno stereotipo algoritmico potrebbe portare a una medicalizzazione eccessiva o a trattamenti non necessari, con tutti i rischi e gli effetti collaterali che ciò comporta. L’idea che questo fenomeno possa essere considerato meramente teorico è errata; infatti, esistono numerosi casi documentati a partire dal 2018, i quali attestano che i sistemi di supporto decisionale nel campo sanitario sono stati capaci, in modo non intenzionale, di manifestare una forma di discriminazione nei confronti dei pazienti neri attraverso l’attribuzione di punteggi elevati al rischio di malattia.